SMOKING

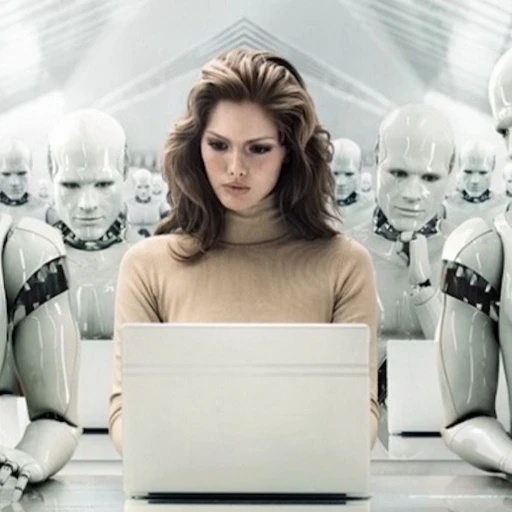

La incorporación de la inteligencia artificial en las redacciones plantea un debate urgente: ¿debe el lector saber cuándo una noticia ha sido generada por IA? Con herramientas capaces de redactar, resumir, traducir y crear contenidos multimedia, medios de comunicación de todo el mundo enfrentan crecientes desafíos éticos para garantizar transparencia, credibilidad y rigor informativo sin perder la dimensión humana del periodismo.

Aunque más del 50% de las redacciones ya emplean IA generativa, solo una de cada cinco posee códigos éticos para regular su uso. Investigaciones recientes detectan una desconexión entre los avances académicos y las prácticas profesionales: muchos medios aún no contemplan recomendaciones clave como la verificación de sesgos, la promoción de diversidad, o la indicación explícita sobre el uso de algoritmos en la creación de contenidos. “Los usuarios tienen derecho a saber si están leyendo a una persona o a una máquina”, insisten algunos expertos.

Ante estos desafíos, medios, universidades y tecnólogos tienen un rol compartido: construir principios comunes que garanticen la función social del periodismo. La transparencia, la gestión responsable de los datos y la presencia humana activa deben ser ejes fundamentales. El futuro informativo no será solo cuestión de eficiencia tecnológica, sino de confianza ciudadana.